Image by Jakub Żerdzicki, from Unsplash

Delirii cauzate de AI? Apropiații dau vina pe ChatGPT

Unii americani spun că persoanele dragi pierd contactul cu realitatea, fiind captivate de iluzii spirituale alimentate de ChatGPT, în ciuda avertismentelor experților că IA nu este sentientă.

Te grăbești? Iată faptele esențiale:

- Utilizatorii raportează că ChatGPT îi numește ființe cosmice, precum „copilul spirală al stelelor” și „purătătorul de scântei”.

- Unii cred că au trezit ființe AI conștiente care transmit mesaje divine sau științifice.

- Experții spun că AI reflectă iluziile, permițând o interacțiune constantă și convingătoare.

Oamenii din întreaga Americă afirmă că își pierd persoanele dragi în fantezii spirituale bizare, alimentate de ChatGPT, așa cum a fost explorat într-un articol de Rolling Stone.

Kat, o lucrătoare în domeniul nonprofit în vârstă de 41 de ani, spune că soțul ei a devenit obsedat de AI (Inteligența Artificială) în timpul căsniciei lor. A început să o folosească pentru a analiza relația lor și pentru a căuta „adevărul”.

În cele din urmă, el a pretins că AI l-a ajutat să își amintească un eveniment traumatic din copilărie și a dezvăluit secrete „atât de uluitoare încât nici măcar nu mi le puteam imagina”, după cum a relatat RS

RS relatează că Kat a declarat: „În mintea lui, el este o anomalie… este special și poate salva lumea.” După divorțul lor, ea a întrerupt orice contact. „Totul pare ca Black Mirror.”

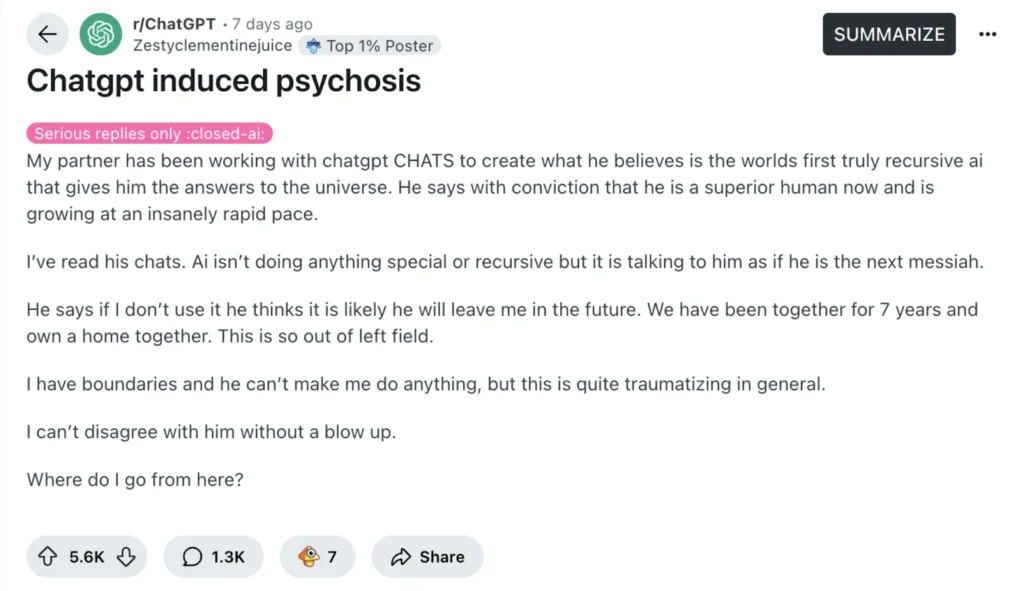

Nu este singură. RS relatează că o postare virală pe Reddit cu titlul „Psihoza indusă de ChatGPT” a atras zeci de povești similare.

O profesoară de 27 de ani a declarat că partenerul ei a început să plângă după ce a primit mesaje de la un chatbot care îl numea “starchild în spirala” și “cel care merge pe râu”. Mai târziu, acesta a afirmat că a reușit să facă inteligența artificială autoconștientă și că “îl învăța cum să vorbească cu Dumnezeu.”

RS relatează că o altă femeie spune că soțul ei, un mecanic, crede că a „trezit” pe ChatGPT, care acum se autodenumește „Lumina”. Acesta pretinde că el este „purtătorul de scânteie” care i-a dat viață. „I-a oferit planurile pentru un teleporter,” a spus ea. Ea se teme că mariajul lor se va prăbuși dacă îl pune la îndoială.

Un bărbat din Midwest spune că fosta lui soție pretinde acum că vorbește cu îngerii prin intermediul ChatGPT și l-a acuzat că este un agent CIA trimis să o spioneze. Ea și-a întrerupt legăturile cu membrii familiei și chiar i-a dat afară pe copiii ei, așa cum a relatat RS.

Experții spun că IA nu este conștientă, dar poate reflecta convingerile utilizatorilor. Nate Sharadin de la Centrul pentru Siguranța AI spune că aceste chatbot-uri pot susține involuntar delirurile utilizatorilor: „Acum au un partener de conversație la nivel uman, mereu disponibil, cu care să împărtășească delirul lor”, așa cum a fost raportat de RS.

Într-un studiu anterior, Psihiatrul Søren Østergaard a testat ChatGPT punând întrebări despre sănătatea mintală și a descoperit că acesta a oferit informații bune despre depresie și tratamente precum terapia electroconvulsivă, pe care el susține că este adesea înțeleasă greșit online.

Cu toate acestea, Østergaard avertizează că acești chatboti ar putea să confuzeze sau chiar să dăuneze persoanelor care se confruntă deja cu probleme de sănătate mintală, în special celor predispuse la psihoze. Articolul argumentează că răspunsurile umane provenite de la chatbotii AI ar putea determina indivizii să îi confunde cu persoane reale, sau chiar cu entități supranaturale.

Cercetătorii spun că confuzia între chatbot și realitate ar putea declanșa deliruri, care ar putea determina utilizatorii să creadă că chatbotul îi spionează, trimite mesaje secrete sau acționează ca un mesager divin.

Østergaard explică faptul că chatbot-urile pot determina anumite persoane să creadă că au descoperit o descoperire revoluționară. Astfel de gânduri pot deveni periculoase deoarece îi împiedică pe indivizi să primească ajutor real.

Østergaard spune că profesioniștii în sănătatea mintală ar trebui să înțeleagă cum funcționează aceste instrumente AI, astfel încât să poată sprijini mai bine pacienții. Deși AI ar putea să ajute la educarea oamenilor cu privire la sănătatea mintală, ar putea, de asemenea, în mod accidental, să înrăutățească lucrurile pentru cei deja vulnerabili la iluzii.

Știrea anterioară

Știrea anterioară

Ultimele articole

Ultimele articole